W zeszłym tygodniu naukowcy z Apple zaprezentowali OpenELM, serię " wydajnych modeli językowychopen-source", opartych na bibliotece modeli Hugging Face. Cztery warianty mają rozmiar od 270 milionów parametrów do 3 miliardów i są najbardziej prawdopodobnymi kandydatami do sztucznej inteligencji na urządzeniach Apple.

Dla kontekstu, Apple po cichu uruchomił framework uczenia maszynowego o nazwie MLX w grudniu 2023 roku. Następny był MLLM-Guided Image Editing (MGIE)po którym nastąpiła seria wysiłków związanych z generatywną sztuczną inteligencją, w tym Keyframer, Ferret-UI i Uzupełnianie kodu AI w Xcode. W większości przypadków projekty te wykorzystują moc obliczeniową krzemu Apple, zamiast przenosić funkcje sztucznej inteligencji do chmury.

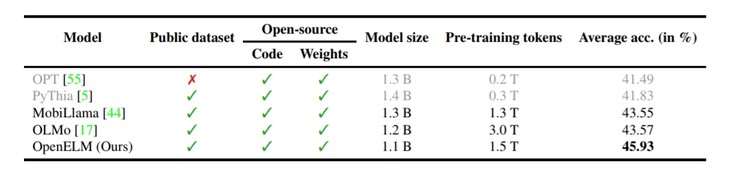

W tym samym duchu OpenELM reprezentuje Apple podejście do sztucznej inteligencji na urządzeniu. Zazwyczaj publiczne modele LLM wykorzystują setki miliardów (czasem biliony) zmiennych do zrozumienia danych wprowadzanych przez użytkownika i podjęcia decyzji o odpowiedniej odpowiedzi. Z drugiej strony, mniejsze modele językowe, takie jak Microsoft's Phi-3 wykorzystują zaledwie 3,8 miliarda parametrów, podczas gdy Google Gemma może pochwalić się 2 miliardami. Jednak ze względu na unikalne podejście OpenELM do architektury modelu transformatora, model ten osiąga zaledwie 270 milionów parametrów.

Oczywiście bycie małym ma pewne wady. Po pierwsze, OpenELM nie jest multimodalny, ponieważ ma zbyt mało parametrów, aby było to wykonalne. Ponadto, jego faktyczna wiedza jest dość niska, jak wykazano w raporcie technicznym https://www.google.com/url?sa=t&source=web&rct=j&opi=89978449&url=https://arxiv.org/abs/2404.14619&ved=2ahUKEwjthIWbmeyFAxXMXEEAHeVICrgQFnoECBQQAQ&usg=AOvVaw0lkrTbxKNgbdUB4po5zOEa . Problem ten dotyczy wszystkich publicznych LLM o podobnych rozmiarach. Niewielki rozmiar pozwala jednak na hostowanie modelu AI lokalnie na telefonach lub laptopach zamiast w chmurze.

Applepubliczne wydanie OpenELM jest odejściem od typowych praktyk firmy. Od kompletnych ram i oceny modelu, po dzienniki treningowe, konfiguracje przedtreningowe i kod wnioskowania MLX, każdy aspekt modelu językowego jest publicznie dostępny za pośrednictwem Hugging Face dla programistów, którzy mogą go dostosowywać i zmieniać jego przeznaczenie do różnych przypadków użycia. Pozornie tak obszerna wersja powinna wzmocnić pozycję Apple w dziedzinie sztucznej inteligencji, inspirując badaczy do zabawy z możliwościami na urządzeniach Apple.

Ale w tej przestrzeni są też inni gracze. Phi-3 Microsoftu jest bardzo kompetentnym rywalem, podobnie jak inne otwarte projekty LLM z Redmond. Kolejnym jest Gemma 2B - 3B firmy Google. Podczas gdy wszystkie wyżej wymienione modele nadal działają zbyt wolno, sprzęt i oprogramowanie z pewnością zmierzają w dobrym kierunku dla małych modeli językowych.

Na razie urządzenia brzegowe, takie jak Samsung Galaxy S24 (od 799 USD na Amazon) lub OnePlus 12R korzystające z wewnętrznego Andes-GPT muszą polegać na przetwarzaniu w chmurze. Niezależnie od tego, czy Apple włączy OpenELM do następnego iPhone'a, jest prawdopodobne, że firma z Cupertino będzie współpracować z Google lub Open AI w zakresie cięższych funkcji generatywnej sztucznej inteligencji.