DeepSeek, chińska firma zajmująca się sztuczną inteligencją, wydała DeepSeek-V3-0324, zaktualizowaną wersję swojego modelu V3 AI large-language model (LLM), który został pierwotnie uruchomiony w grudniu 2024 roku. Model V3 zaskoczył świat ze względu na znacznie niższe wymagania sprzętowe, krótszy czas szkolenia i niższe koszty API, a jednocześnie wysoką wydajność w porównaniu z konkurencyjnymi sztucznymi inteligencjami, takimi jak modele GPT OpenAI.

Zaktualizowany model V3 jest modelem sztucznej inteligencji bez rozumowania, co oznacza, że stara się szybko odpowiadać na pytania i nie poświęca dodatkowego czasu na przemyślenie trudnych problemów, w przeciwieństwie do modelu R1 DeepSeek. Jego rozmiar wynoszący 685 miliardów parametrów plasuje go wśród największych publicznie dostępnych modeli LLM. Najnowszy model jest dostępny do użytku na licencji MIT.

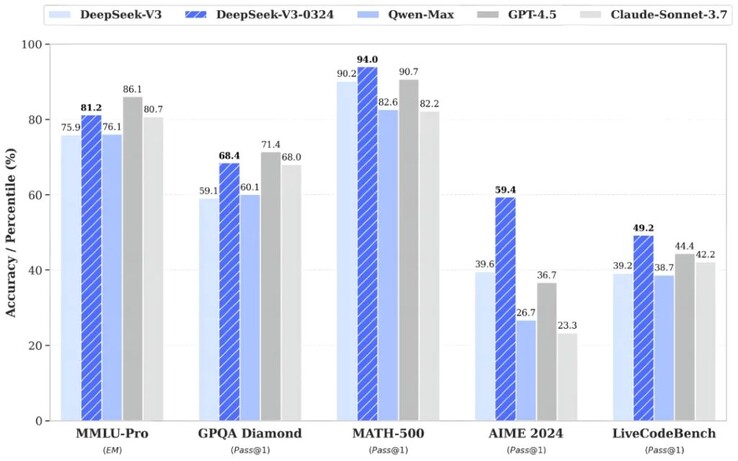

DeepSeek-V3-0324 uzyskał w testach porównawczych AI wyniki od 5,3% do 19,8% wyższe niż oryginalny model V3. Jego wydajność jest porównywalna z innymi topowymi AI, takimi jak GPT-4.5 i Claude Sonnet 3.7

Zaktualizowany model ma również ulepszone możliwości. Jednym z obszarów ulepszeń jest udoskonalona zdolność do tworzenia atrakcyjnych stron internetowych i front-endów dla gier online. Kolejnym ulepszeniem jest możliwość lepszego wyszukiwania, pisania i tłumaczenia w języku chińskim.

Czytelnicy chcący poeksperymentować z pełną wersją 685B DeepSeek-V3-0324 będą potrzebować co najmniej 700 GB wolnej przestrzeni dyskowej i wielu procesorów graficznych Nvidia A100/H100. Wydestylowane wersje modelu o mniejszych parametrach można uruchomić na pojedynczym procesorze graficznym, takim jak Nvidia 3090(sprzedawany tutaj na Amazon).

DeepSeek-V3-0324 Wydanie

Znaczne zwiększenie wydajności rozumowania

Większe umiejętności programowania front-end

Inteligentniejsze możliwości korzystania z narzędzi

W przypadku niezłożonych zadań wnioskowania zalecamy korzystanie z wersji V3 - wystarczy wyłączyć "DeepThink"

Użycie API pozostaje niezmienione

Modele są teraz udostępniane na licencji MIT, podobnie jak DeepSeek-R1!

Wagi open-source: huggingface.co/deepseek-ai/DeepSeek-V3-0324