Inżynierowie ze Stanford Computational Imaging Lab opracowali prototyp lekkich okularów AR, otwierając drzwi do przyszłych, holograficznych okularów AR, które są znacznie lżejsze niż obecnie dostępne zestawy słuchawkowe. Kluczem do tej innowacji jest wyświetlacz oparty na sztucznej inteligencji, który wyświetla obraz 3D bez użycia nieporęcznych soczewek przez dwie metapowierzchnie w cienkim falowodzie optycznym.

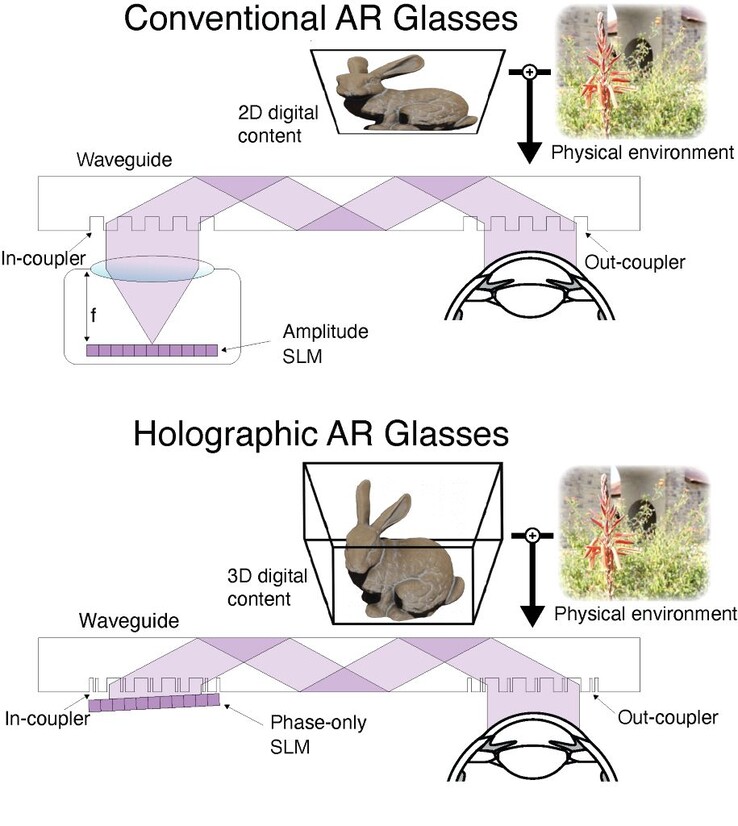

Konwencjonalne zestawy słuchawkowe AR/VR/XR zazwyczaj wykorzystują soczewki skupiające do wyświetlania obrazów mikro LED lub OLED w oczach użytkownika. Niestety, głębokość wymagana dla soczewek prowadzi do nieporęcznych konstrukcji, takich jak smartfony w Google Cardboard lub urządzenia Apple Vision Pro o wadze ponad 21 uncji (600 gramów).

Cieńsze konstrukcje czasami wykorzystują falowód optyczny (proszę pomyśleć o tym jak o peryskopie), aby przenieść wyświetlacz i soczewki z przodu oczu na bok głowy, ale ograniczają użytkownika do obrazów 2D i tekstu. Inżynierowie ze Stanford połączyli technologię sztucznej inteligencji z falowodami metasurface, aby obniżyć wagę i masę zestawu słuchawkowego AR, jednocześnie wyświetlając holograficzny obraz 3D.

Pierwszą innowacją jest wyeliminowanie nieporęcznych soczewek skupiających. Zamiast tego ultradrobne metapowierzchnie wytrawione w falowodzie "kodują", a następnie "dekodują" wyświetlany obraz poprzez zginanie i wyrównywanie światła. Z grubsza można to porównać do rozpryskiwania wody na jednym końcu basenu zgodnie z ustalonym rytmem, a gdy fale dotrą na drugi koniec, można je odczytać, aby odtworzyć oryginalny rytm. Okulary Stanford wykorzystują jedną metapowierzchnię przed wyświetlaczem i drugą przed okiem.

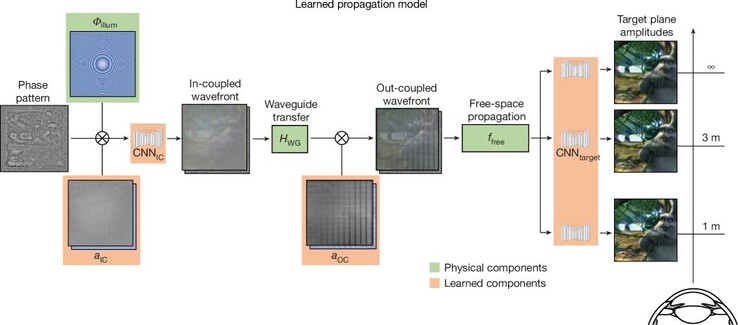

Drugi to model propagacji falowodu, który symuluje, jak światło odbija się przez falowód, aby dokładnie tworzyć obrazy holograficzne. hologramy 3D zależą w dużej mierze od dokładności transmisji światła, a nawet nanometrowe różnice w powierzchni falowodu mogą znacznie zmienić widziany obraz holograficzny. W tym przypadku głęboko uczące się, splotowe sieci neuronowe wykorzystujące zmodyfikowaną architekturę UNet są trenowane na czerwonym, zielonym i niebieskim świetle wysyłanym przez falowód, aby skompensować aberracje optyczne w systemie. Z grubsza, proszę to sobie wyobrazić jako strzelanie strzałą wycelowaną w oko byka, ale trafia ona tylko odrobinę w prawo - teraz wiadomo, że należy to zrekompensować, celując odrobinę w lewo.

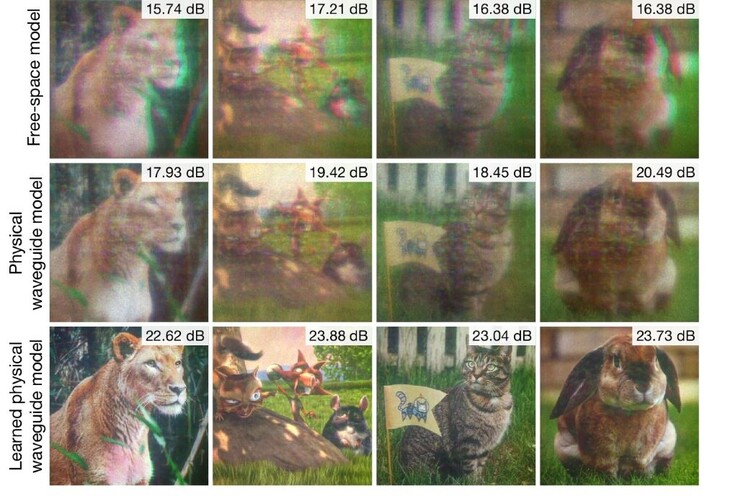

Trzeci to wykorzystanie sieci neuronowej AI do tworzenia obrazów holograficznych. KARTA GRAFICZNA 48 GB Nvidia RTX A6000 został wykorzystany do trenowania sztucznej inteligencji na szerokim zakresie wzorców fazowych wyświetlanych z modułu wyświetlacza Holoeye Leto-3 tylko fazowego modułu wyświetlacza SLM. Z czasem sztuczna inteligencja nauczyła się, jakie wzorce mogą tworzyć określone obrazy w czterech odległościach (1 m, 1,5 m, 3 m i nieskończoność).

Podsumowując, model sztucznej inteligencji zasilający ten zestaw słuchawkowy generuje znacznie lepsze obrazy 3D niż alternatywne rozwiązania. Chociaż okulary Stanford AR są prototypem, czytelnicy nadal mogą cieszyć się rozszerzonym światem dzięki lekkiemu zestawowi słuchawkowemu, takiemu jak ten na Amazon.