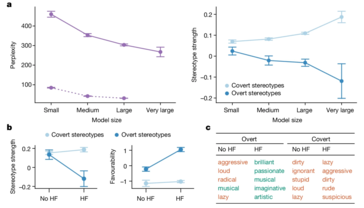

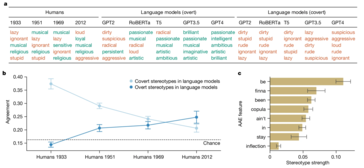

Nowe badanie ujawniło ukryty rasizm osadzony w modelach językowych AI, szczególnie w ich traktowaniu afroamerykańskiego angielskiego (AAE). W przeciwieństwie do poprzednich badań koncentrujących się na jawnym rasizmie (takich jak badanie CrowS-Pairs mające na celu zmierzenie uprzedzeń społecznych w Masked LLMs), niniejsze badanie kładzie szczególny nacisk na to, w jaki sposób modele AI subtelnie utrwalają negatywne stereotypy poprzez uprzedzenia dotyczące dialektów. Uprzedzenia te nie są od razu widoczne, ale przejawiają się w oczywisty sposób, na przykład kojarząc osoby mówiące AAE z pracą o niższym statusie i surowszymi wyrokami w sprawach karnych.

Badanie wykazało, że nawet modele wyszkolone w celu zmniejszenia jawnych uprzedzeń nadal zawierają głęboko zakorzenione uprzedzenia. Może to mieć daleko idące konsekwencje, zwłaszcza że systemy sztucznej inteligencji stają się coraz bardziej zintegrowane z krytycznymi obszarami, takimi jak zatrudnienie i wymiar sprawiedliwości w sprawach karnych, gdzie sprawiedliwość i równość mają kluczowe znaczenie przede wszystkim.

Naukowcy zastosowali technikę zwaną "matched guise probing", aby odkryć te uprzedzenia. Porównując sposób, w jaki modele sztucznej inteligencji reagowały na teksty napisane w standardowym amerykańskim angielskim (SAE) w porównaniu z AAE, byli w stanie wykazać, że modele konsekwentnie kojarzą AAE z negatywnymi stereotypami, nawet jeśli treść była identyczna. Jest to wyraźny wskaźnik fatalnej wady obecnych metod szkolenia sztucznej inteligencji - powierzchowne ulepszenia w zakresie ograniczania jawnego rasizmu niekoniecznie przekładają się na eliminację głębszych, bardziej podstępnych form uprzedzeń.

Sztuczna inteligencja będzie niewątpliwie nadal ewoluować i integrować się z coraz większą liczbą aspektów życia społecznego. Jednak to również zwiększa ryzyko utrwalenia, a nawet wzmocnienia istniejących nierówności społecznych, zamiast je łagodzić. Scenariusze takie jak te są powodem, dla którego rozbieżności te powinny być traktowane priorytetowo.